Cómo Detectar Desastres de SEO Técnico Antes que Googlebot

La Optimización de Motores de Búsqueda (SEO) es un juego de ajedrez. Trabaja durante meses y aumenta su tráfico orgánico en un 300%. Luego, un viernes por la tarde, el equipo de desarrollo lanza una actualización de la interfaz de usuario que parece inocente. Llega a la oficina el lunes por la mañana y descubre que su página de categoría con más tráfico ha sido eliminada de Google.

¿El motivo? Al renderizar el nuevo componente de React, el <link rel="canonical"> dentro de la etiqueta <head> se rompió, o la única etiqueta <h1> de la página se ocultó accidentalmente.

En este artículo, examinaremos la arquitectura de monitoreo proactivo que le permite detectar desastres de SEO Técnico inducidos por el despliegue de código segundos antes de que los Googlebots rastreen su sitio.

1. ¿Cuáles Son los Asesinos Silenciosos del SEO?

Dado que el contenido se genera dinámicamente en los marcos modernos de JavaScript (Next.js, Nuxt, etc.), un error de CSS o JS puede arruinar directamente la salida HTML. Los "Asesinos Silenciosos del SEO" más comunes son:

- Falta de Etiquetas H1 o Meta: Un pequeño error en un componente Layout global puede eliminar la etiqueta

<title>de todas las páginas de su sitio. - Errores Canónicos: Los sistemas de filtrado o paginación mal configurados pueden hacer que miles de sus páginas pasen repentantemente al estado de "contenido duplicado".

- "noindex" Accidental: El comando

meta robots="noindex"trasladado accidentalmente del entorno de prueba (Staging) al entorno de producción puede eliminar todo su sitio de Google en unos pocos días.

2. Enfoque Reactivo vs. Proactivo

La mayoría de las empresas notan los errores de SEO días después (reactivo) a través de Ahrefs o Google Search Console. Estas herramientas le alertan después de que el tráfico comienza a disminuir. Pero el daño ya está hecho; recuperar sus posiciones puede llevar semanas.

Lo que necesitan los equipos empresariales es una línea de defensa Proactiva. Necesita recibir una notificación "no cuando ocurre el fallo, sino en el segundo exacto en que el código entra en producción".

3. Protección del SEO con el Monitoreo DOM de Crawlens

Crawlens, conocido por sus pruebas visuales, no tiene rival en la captación de cambios semánticos en el árbol DOM. Puede configurar la herramienta Crawlens en su canalización de CI/CD para inspeccionar no solo roturas visuales, sino también "Roturas Invisibles de SEO".

¿Cómo Proporciona Protección Crawlens?

- Línea de Base del DOM: Crawlens registra la Línea de Base (la estructura DOM central) de su sitio cuando tiene una puntuación de SEO perfecta.

- Rastreo Periódico o Activado: Cuando se lanza una nueva versión o se activa un Crawlens Job, su sitio se vuelve a analizar.

- Análisis de Etiquetas, No Solo Píxeles: Crawlens no solo busca desviaciones en las capturas de pantalla. Al comparar el árbol DOM, le envía directamente este mensaje: "¡PRECAUCIÓN! El

<h1 class="hero-title">que existía en la versión anterior no se encontró en el DOM en este nuevo despliegue." - Intervención de Emergencia: Antes de que Googlebot rastree su sitio (lo que normalmente demora horas / días dependiendo del presupuesto de rastreo), soluciona el error y retira (rollback) su código.

Conclusión

El SEO técnico es un activo de marketing demasiado valioso para dejarlo al azar. No agregue los retrasos de Google Search Console al estrés que los errores basados en código ponen sobre sus hombros. Mantenga la arquitectura SEO técnica de su sitio en un radar de inspección las 24 horas del día, los 7 días de la semana antes que los bots de Google con las capacidades de Monitoreo Profundo del DOM de Crawlens, logrando asegurar sus clasificaciones.

Explora Nuestras Soluciones

Descubre las herramientas que elevarán la calidad de tu software.

Artículos Relacionados

Cómo Detectar Errores Silenciosos de UI por Actualizaciones de CSS

Aprenda a detectar errores visuales de UI y regresiones de CSS que escapan a las pruebas manuales utilizando metodologías de Visual Testing automatizadas.

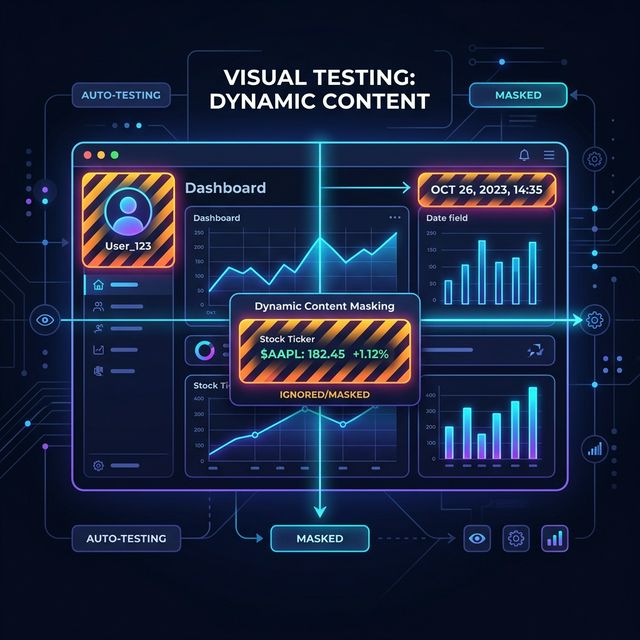

Cómo Hacer Pruebas Visuales en Páginas con Contenido Dinámico

Aprenda estrategias de Enmascaramiento y Tolerancia para probar de manera impecable fechas que cambian constantemente, avatares de perfil y cifras en tiempo real.

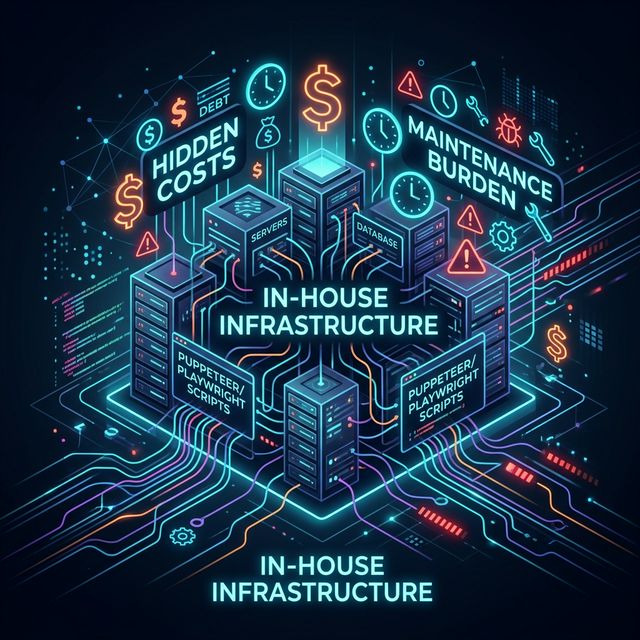

Los Costos Ocultos de Construir una Infraestructura de Pruebas Interna con Playwright/Puppeteer

Exploramos los costos invisibles de servidor y mantenimiento de construir un sistema de pruebas visuales interno, comparándolo con alternativas SaaS (Construir vs Comprar).